بر اساس مطالعات انجام شده توسط مرکز تحقیقاتی Pew، اکثر شهروندان بهداشتی ایالات متحده فکر می کنند که هوش مصنوعی در مراقبت های بهداشتی آمریکا خیلی سریع به کار گرفته می شود، و بر اساس مطالعات مصرف کنندگان از مرکز تحقیقات پیو، “ناراحتی قابل توجهی … با ایده استفاده از هوش مصنوعی در مراقبت های بهداشتی خود احساس می کنند.”

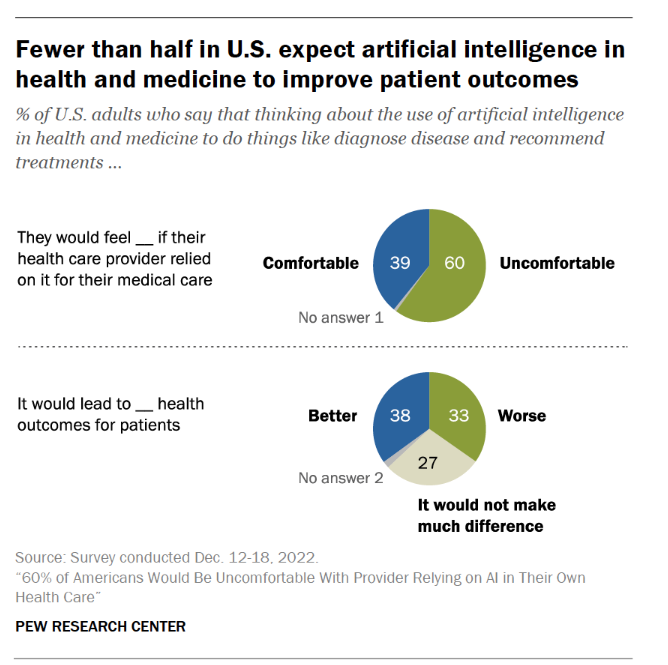

نکته اصلی این است که 60 درصد آمریکاییها از آن ناراحت هستند [their health] ارائهدهندهای که برای مراقبت از خود به هوش مصنوعی تکیه میکند، در یک نظرسنجی مصرفکننده که در دسامبر 2022 در میان بیش از 11000 بزرگسال آمریکایی انجام شد، یافت شد.

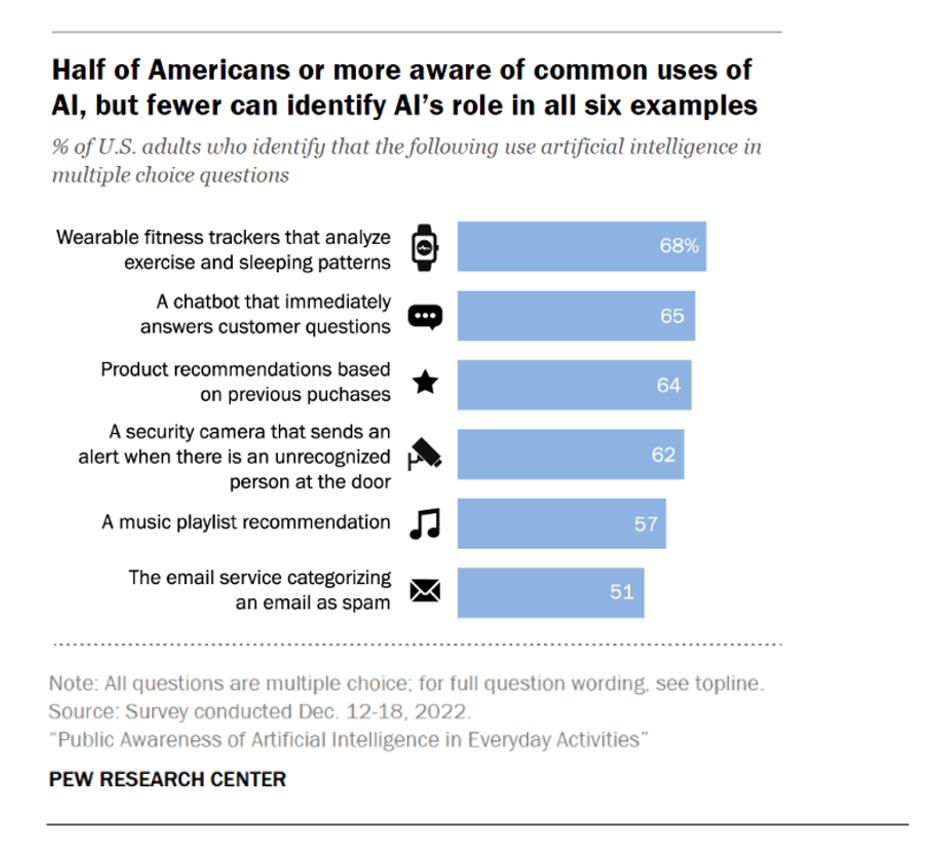

بیشتر مصرفکنندگانی که از کاربردهای رایج هوش مصنوعی آگاه هستند، ردیابهای تناسب اندام پوشیدنی را میدانند که میتوانند ورزش و الگوهای خواب را تجزیه و تحلیل کنند، بهعنوان یک برنامه برتر سلامت/تندرستی برای این فناوری. نمونههای رایج دیگر هوش مصنوعی در زندگی روزمره عبارتند از رباتهای چت که به سؤالات مشتریان پاسخ میدهند، توصیههای محصول بر اساس خریدهای قبلی و دوربینهای امنیتی که هنگام «دیدن» یک فرد ناشناس در درب خانه، هشدار ارسال میکنند.

مرکز تحقیقاتی پیو بر اساس دادههای جمعآوریشده در نظرسنجی مصرفکنندگان در دسامبر 2022، چندین تحلیل منتشر کرده است. من در اینجا روی چند مورد از دادههای بهداشتی/مراقبتی تمرکز میکنم، اما توصیه میکنم کل مجموعه گزارشها را مرور کنید تا بدانید مصرفکنندگان آمریکایی چگونه به هوش مصنوعی در زندگی روزمره نگاه میکنند.

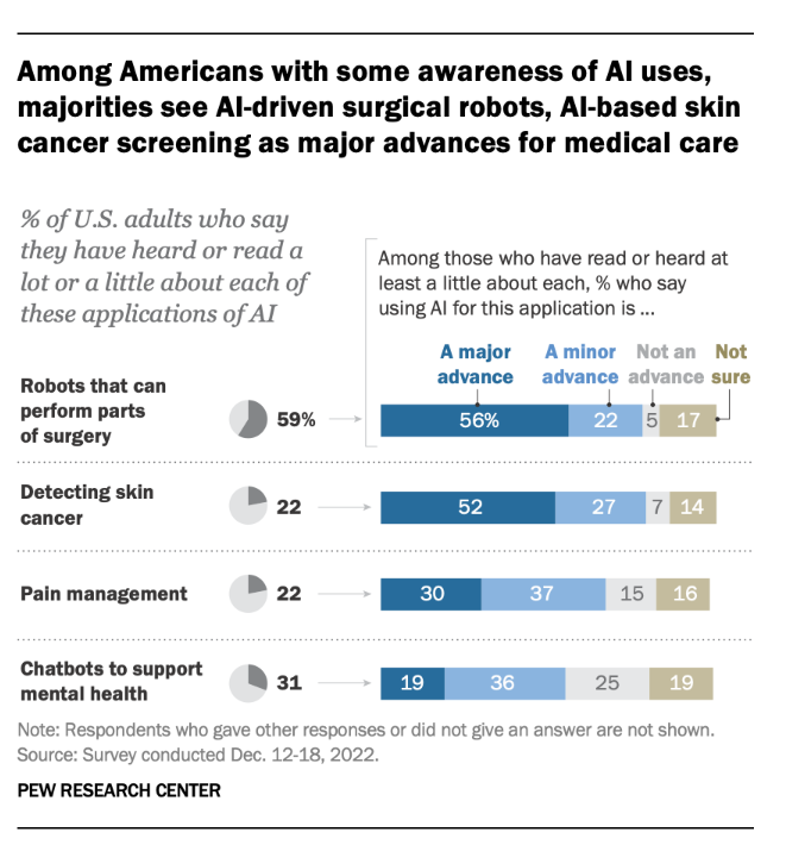

در میان مصرفکنندگان آمریکایی که از کاربردهای هوش مصنوعی آگاه هستند، بیش از نیمی از رباتهایی که میتوانند جراحی انجام دهند و همچنین ابزارهای هوش مصنوعی که میتوانند سرطان پوست را تشخیص دهند، پیشرفتهای عمدهای در مراقبتهای پزشکی هستند.

برای مدیریت درد و چت بات ها برای سلامت روان؟ نه چندان پیشرفت های بزرگ به اندازه پیشرفت های جزئی که یک سوم مصرف کنندگان آن را درک می کنند.

برای سلامت روان، 46 درصد از مصرفکنندگان فکر میکردند که چت رباتهای هوش مصنوعی فقط باید توسط افرادی استفاده شود که به درمانگر نیز مراجعه میکنند. این نظر تقریباً به همان نسبت افرادی بود که در مورد چت ربات های هوش مصنوعی برای سلامت روان شنیده بودند با افرادی که در مورد استفاده از چت ربات های هوش مصنوعی برای سلامت روان نمی دانستند.

کمتر از نیمی از مردم انتظار دارند هوش مصنوعی در سلامت و پزشکی باعث بهبود نتایج بیماران شود. توجه داشته باشید که یک سوم مردم انتظار دارند هوش مصنوعی منجر به نتایج بدتری برای سلامتی شود.

خطاهای پزشکی همچنان مراقبت های بهداشتی آمریکا را به چالش می کشد. حدود 4 نفر از هر 10 نفر به پتانسیل هوش مصنوعی برای کاهش تعداد اشتباهات ارائه دهندگان مراقبت های بهداشتی و همچنین فرصتی برای هوش مصنوعی برای رسیدگی به سوگیری های مراقبت های بهداشتی و برابری سلامت نگاه می کنند.

این فرصت مهمی برای برنامههای کاربردی هوش مصنوعی در مراقبتهای بهداشتی ایالات متحده است: از هر سه بزرگسال سیاهپوست دو نفر میگویند که تعصب بر اساس نژاد یا قومیت بیماران همچنان یک مشکل بزرگ در سلامت و پزشکی است و یک چهارم دیگر تعصب را جزئی عنوان میکنند. مشکلی که در مطالعه Pew یافت شد.

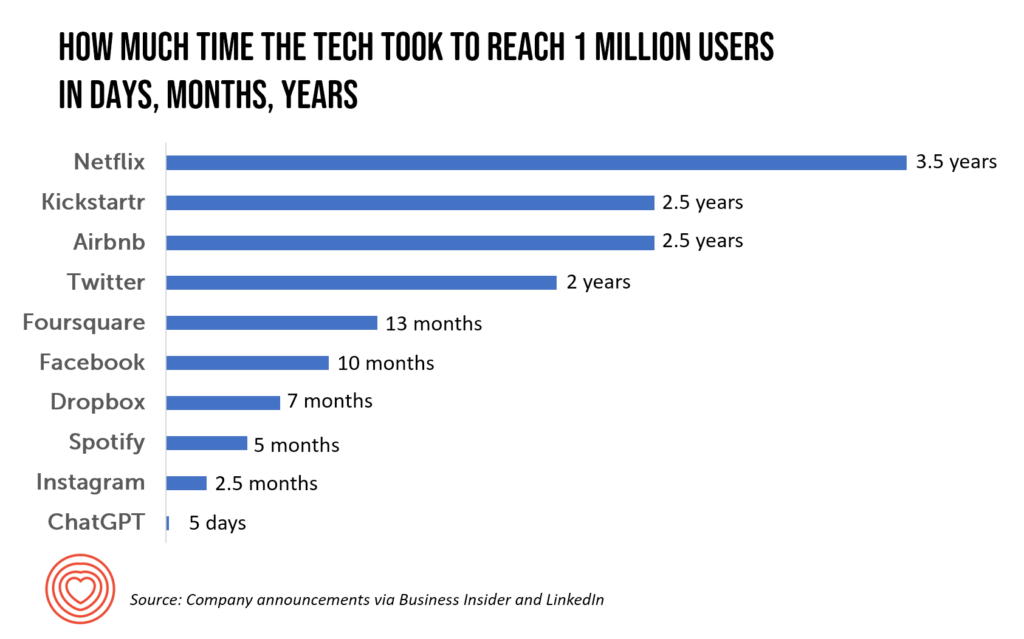

نکات داغ Health Populi: از آنجایی که صنعت به حرکت سریعتر و سریعتر به سمت هوش مصنوعی ادامه میدهد، و در حال حاضر منحنی S-استیک هاکی ChatGPT اتخاذ شده است، رسانههای جمعی این موضوع را پوشش میدهند تا به مصرفکنندگان کمک کنند تا با این فناوری همگام شوند. USA Today مقاله ای متوازن و تحقیق شده با عنوان “ChatGPT آماده است اطلاعات پزشکی را تغییر دهد. خوب و بد.»

کارن واینتراب در پوشش خود به ما یادآوری می کند: «ChatGPT پیشنمایش تحقیقاتی خود را در دوشنبه ماه دسامبر راهاندازی کرد [2022]. در آن روز چهارشنبه، طبق گزارش ها، 1 میلیون کاربر داشت. در ماه فوریه، مایکروسافت و گوگل اعلام کردند که قصد دارند برنامههای هوش مصنوعی مشابه ChatGPT را در موتورهای جستجوی خود قرار دهند.

دکتر Ateev Mehrotra از هاروارد و Beth Israel Deaconess، که همیشه نیرویی از داده های خوب و مراقبت های بهداشتی مبتنی بر شواهد است، افزود: بهترین کاری که میتوانیم برای بیماران و عموم مردم انجام دهیم این است (بگوییم)، هی، این ممکن است یک منبع مفید باشد، اطلاعات مفید زیادی دارد – اما اغلب اشتباه میکند و به این موضوع عمل نکنید. اطلاعات فقط در فرآیند تصمیم گیری شماست.”

و دکتر جان هالامکا، که اکنون رئیس پلتفرم کلینیک مایو است، به این نتیجه رسید که اگرچه هوش مصنوعی و ChatGPT جایگزین آنها نمیشوند، “پزشکانی که از هوش مصنوعی استفاده میکنند احتمالا جایگزین پزشکانی خواهند شد که از هوش مصنوعی استفاده نمیکنند.” دکتر هالامکا همچنین اخیراً در مورد پیشرفت های هوش مصنوعی و ChatGPT در مراقبت های بهداشتی در این پخش اینترنتی AMA Update بحث کرده است.

از دیدگاه بیمار، ستون مایکل ال. میلنسون را بررسی کنید فوربس بحث در مورد اینکه چگونه در سرطان، هوش مصنوعی می تواند بیماران را توانمند کند و روابط آنها را با پزشکان و سیستم مراقبت تغییر دهد.

مقاله اخیر در گفتگو، که توسط یک متخصص اخلاق پزشکی نوشته شده است، طیفی از مسائل اخلاقی را که پذیرش Chat-GPT در مراقبت های بهداشتی می تواند ارائه دهد، بررسی کرد. نقض حریم خصوصی دادههای بیمار، از بین رفتن اعتماد بیمار، نحوه تولید دقیق شواهدی مبنی بر سودمندی این فناوری، و تضمین ایمنی در ارائه مراقبتهای بهداشتی از جمله خطراتی است که نویسندگان به آن اشاره میکنند، و همچنین پتانسیل ایجاد شکاف دیجیتال و سلامت بیشتر است. نابرابری ها

واکس این هفته مقاله ای را منتشر کرد که در آن به کاهش سرعت پذیرش هوش مصنوعی استدلال می کرد. سیگال ساموئل اظهار داشت: «ترمز کردن هوش مصنوعی میتواند بهترین کاری باشد که تا به حال برای بشریت انجام دادهایم.» او استدلال میکند که “پیشرفت در هوش مصنوعی اخیراً چنان با سرعت باورنکردنی در حال حرکت است که این سوال اجتناب ناپذیر شده است: تا کی تا زمانی که هوش مصنوعی بر دنیای ما تسلط داشته باشد تا جایی که ما به جای پاسخگویی به ما به آن پاسخ دهیم؟”

سیگال سه ایرادی را که طرفداران هوش مصنوعی در این مرحله نوپای پذیرش صعودی مطرح میکنند، از بین میبرد:

- اعتراض 1: “پیشرفت فناوری اجتناب ناپذیر است و تلاش برای کاهش سرعت آن بیهوده است”

- اعتراض 2: “ما نمی خواهیم مسابقه تسلیحاتی هوش مصنوعی با چین را از دست بدهیم” و

- اعتراض 3: “ما باید با هوش مصنوعی پیشرفته بازی کنیم تا بفهمیم چگونه هوش مصنوعی پیشرفته را ایمن کنیم.”

دیروز، مایکروسافت و Nuance ابزار مستندسازی بالینی خودکار خود را که با GPT-4 و مدل “مکالمه” (یعنی چت) تعبیه شده است، اعلام کردند.

با توجه به پذیرش سریع هوش مصنوعی در مراقبت های پزشکی، و ChatGPT به عنوان یک مورد استفاده، همه ما به عنوان بیماران و مراقبان و کارگران در اکوسیستم بهداشتی/مراقبتی تحت تاثیر این فناوری قرار خواهیم گرفت. بر همه ما واجب است که به روز بمانیم، صادق و شفاف بمانیم، و برای آموختن اینکه چه چیزی موثر است و چه چیزی مفید نیست، باز بمانیم. و برای اطمینان از اعتماد بین بیماران، پزشکان و سیستم مراقبتهای بهداشتی بزرگتر، باید با احساس حریم خصوصی و برابری بر اساس طراحی عمل کنیم، به احساس ارزشها و ارزش مردم احترام بگذاریم و با شفافیت و احترام برای همه رفتار کنیم.

در حالت امیدوارانه، دکتر جان هالامکا گفتگوی خود را در AMA Update با این دیدگاه خوش بینانه به پایان رساند: «پس چطور در مورد این – اگر در نسل من، ما بتوانیم 50 درصد بار را برداریم، نسل بعدی در عمل لذت خواهد برد. “

فعلاً این بحث را خاتمه میدهیم و برای شما آرزوی شادی در جریان کار و زندگیتان دارم!

این پست هنگامی که نوبت به مراقبت از سلامتی آنها میرسد، ارتباط هوش مصنوعی قطع میشود – بینشهای مرکز تحقیقات پیو اولین بار در HealthPopuli.com ظاهر شد.